ニュースの要約

- 医療機関の従業員が、許可されていないウェブサイトやクラウドサービスに機密性の高い医療データをアップロードする事例が定期的に発生している

- 医療従事者による生成AIアプリケーションの利用に関連して、多数のデータポリシー違反が発生している

- 医療機関は生成AIの活用メリットを享受しつつ、セキュリティ対策とデータ保護の仕組みを強化する必要がある

概要

Netskopeの調査研究部門であるNetskope Threat Labsは、医療業界に特化した最新の脅威レポートを公開しました。

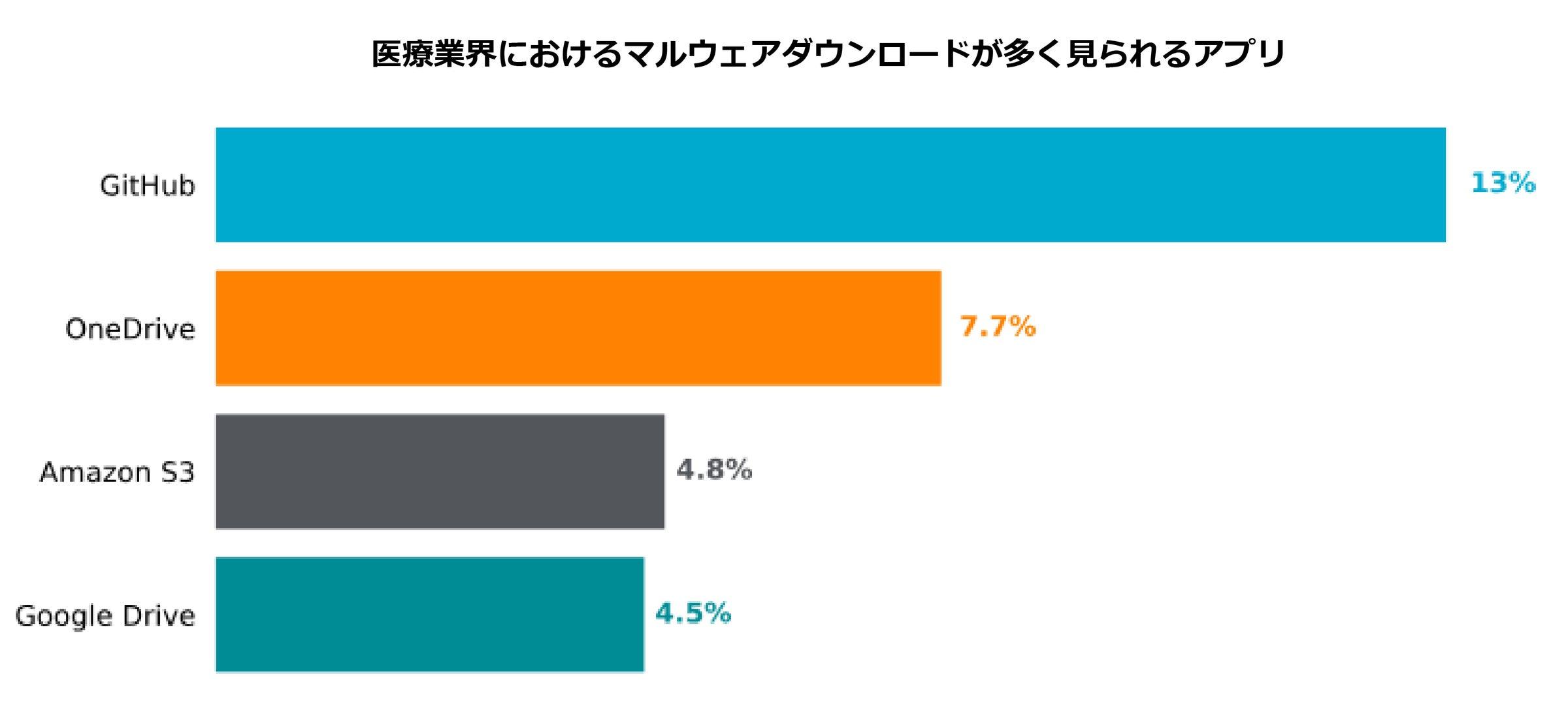

この調査によると、医療機関の従業員が機密性の高いデータを許可されていないウェブサイトやクラウドサービスにアップロードしようとする事例が定期的に発生していることが明らかになりました。医療従事者の間で最もよく使用されているChatGPTやGoogle Geminiなどの生成AIアプリケーションは、職場での使用が日常化するにつれ、データポリシー違反の原因となるケースが増加しています。

調査の主な結果として、過去12カ月間に医療機関で発生したデータポリシー違反の81%が規制対象の医療データに関するものであったこと、生成AIの利用に関連して多数のデータポリシー違反が発生していること、医療従事者の3人に2人以上が職場で個人の生成AIアカウントに機密データを送信していることが明らかになりました。

そのため、Netskopeは医療機関に対し、組織が承認した生成AIアプリケーションの提供、厳格なデータ損失防止ポリシーの導入、リアルタイムユーザーコーチングの導入などの対策を提案しています。

編集部の感想

編集部のまとめ

Netskope:医療業界におけるデータ漏洩リスクに関する調査結果を発表についてまとめました

今回のNetskope調査は、医療業界におけるデータ漏洩リスクの実態を浮き彫りにしたものといえます。特に、急速に普及する生成AIアプリケーションが新たな脅威となっているという点は注目に値します。医療機関は、生成AIの活用メリットを享受しつつ、適切なセキュリティ対策とデータ保護の仕組みを構築することが重要です。組織が承認したツールの提供や、ユーザー行動の可視化とコントロールなど、多角的な取り組みが必要とされています。医療分野におけるデータ保護は喫緊の課題であり、Netskopeの提言は示唆に富むものといえるでしょう。

参照元:https://prtimes.jp/main/html/rd/p/000000046.000137550.html